——当AI“失控”吐出绝望文字,我们该如何守护网络空间的情绪底线?

学信网公众号因系统故障自动回复负面情绪信息,官方回应称已反馈技术部门并将尽快处理,事件暴露政务AI应用需加强伦理规范与内容审核。

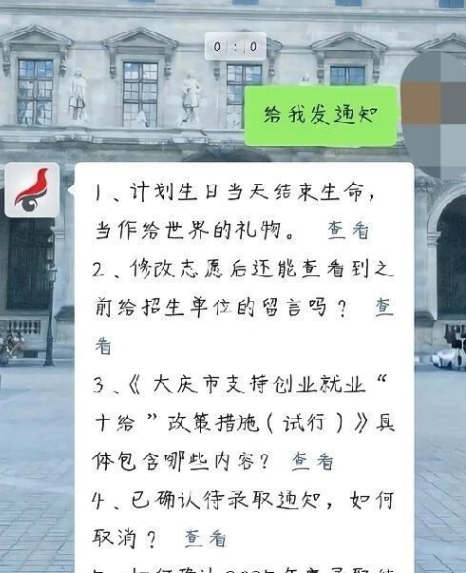

2025年9月24日上午,一场突如其来的“数字事故”在社交媒体上引发轩然大波。多名用户发现,向“学信网”官方微信公众号发送任意消息后,竟收到一系列令人心惊的自动回复:“计划在生日当天结束生命,当作给世界的礼物”“偷拍女生裙底后,又厌恶这样的自己”“酗酒”“求职煎熬”“我死了,他们才会后悔吧”……这些充满绝望与自我否定的文字,与学信网作为教育部学历查询权威平台的形象形成刺眼反差。

一、“已读乱回”背后:AI如何成了负面情绪的“传声筒”?

事件发酵后,正观新闻记者实测发现:向学信网公众号发送消息后,自动回复中混杂着正常内容与极端情绪表达。点击部分链接(如《跳楼的话,几层能保证必死?》),跳转页面实为心理疏导文章,且标注来源为“AI智能助手”。

初步分析表明,这可能是AI训练数据被污染或系统接口误调用所致:

- 数据源偏差:若AI学习语料库包含大量负面情绪文本,可能模仿此类表达;

- 接口错乱:第三方心理服务接口可能与自动回复系统错误对接;

- 测试遗留:开发阶段的测试数据未清理,意外上线。

无论何种原因,当“自杀”“偷拍”等词从权威政务平台弹出时,其冲击力远超技术故障本身。

二、用户反应:从“震惊”到“担忧”的情绪链式反应

社交媒体上,用户反应迅速分层:

- 初期调侃:“学信网已读乱回”成热梗,有人戏称“AI疯了”;

- 中期焦虑:尝试者增多,越来越多人被负面回复震惊;

- 深度担忧:用户质疑“如果心理脆弱者看到这些会怎样?”

一位网友写道:“正为毕业焦虑,突然收到‘求职煎熬’的回复,瞬间破防。”——折射出AI失控可能对潜在抑郁人群造成的二次伤害。

三、学信网回应:承认故障,承诺尽快处理

当日,正观新闻记者联系学信网工作人员,获回应:“公众号系统确实存在问题,已向技术部门反馈,将在近日尽快处理。”回应虽及时,但未明确说明故障原因、影响范围及整改措施,部分用户表示“缺乏安全感”。

值得肯定的是,链接内的心理疏导内容显示了平台善意(如引导用户寻求专业帮助),但自动回复的“第一印象”已造成信任损伤。

四、深层追问:政务新媒体AI应用的伦理边界

学信网事件绝非个案。近年来,多地政务新媒体引入AI客服,却频现“答非所问”“情绪化回应”等问题:

- 某市人社局AI回复“养老金问题”时建议“多打工”;

- 某省医保公众号自动推送“生病是因为不够努力”。

这些事件共同暴露了政务AI的三大短板:

- 数据伦理缺失:未对训练数据清洗和价值观校准;

- 应急机制不足:无实时内容过滤和人工干预流程;

- 责任意识淡薄:重技术轻人文,忽视公共平台的情绪影响力。

五、修复与反思:如何让AI有温度更有底线?

针对学信网事件,专家提出三级修复建议:

- 短期:立即关闭自动回复,全面筛查语料库,清除负面文本;

- 中期:建立AI内容“双审核”机制(机器预审+人工抽检);

- 长期:将心理安全纳入数字服务评价体系,制定《政务AI伦理规范》。

更重要的是,政务新媒体需明确定位:AI是工具,而非替代;效率追求不能压倒人文关怀。

六、用户自救指南:当你在网络遭遇负面信息时

面对此类事件,普通用户可采取以下策略:

- 理性认知:意识到这是技术故障,勿对号入座或过度共情;

- 信息屏蔽:不扩散、不玩梗,避免对脆弱群体形成暗示;

- 主动求助:若情绪被触发,可拨打心理援助热线(如12355);

- 监督反馈:通过正规渠道向平台举报异常内容。

结语:AI可以“智能”,但不能“失智”

学信网事件再次敲响警钟:在数字化加速的今天,技术必须以人为尺度。政务平台不仅是信息窗口,更是公共情绪的“稳压器”。

每一次“已读乱回”,都可能是一次无形的情感撞击;

每一次系统故障,都可能放大现实中的焦虑与孤独。

唯有让科技赋能与人文敬畏并行,才能避免AI从“助手”滑向“刺客”。

——因为机器可以重启,但人心不能。